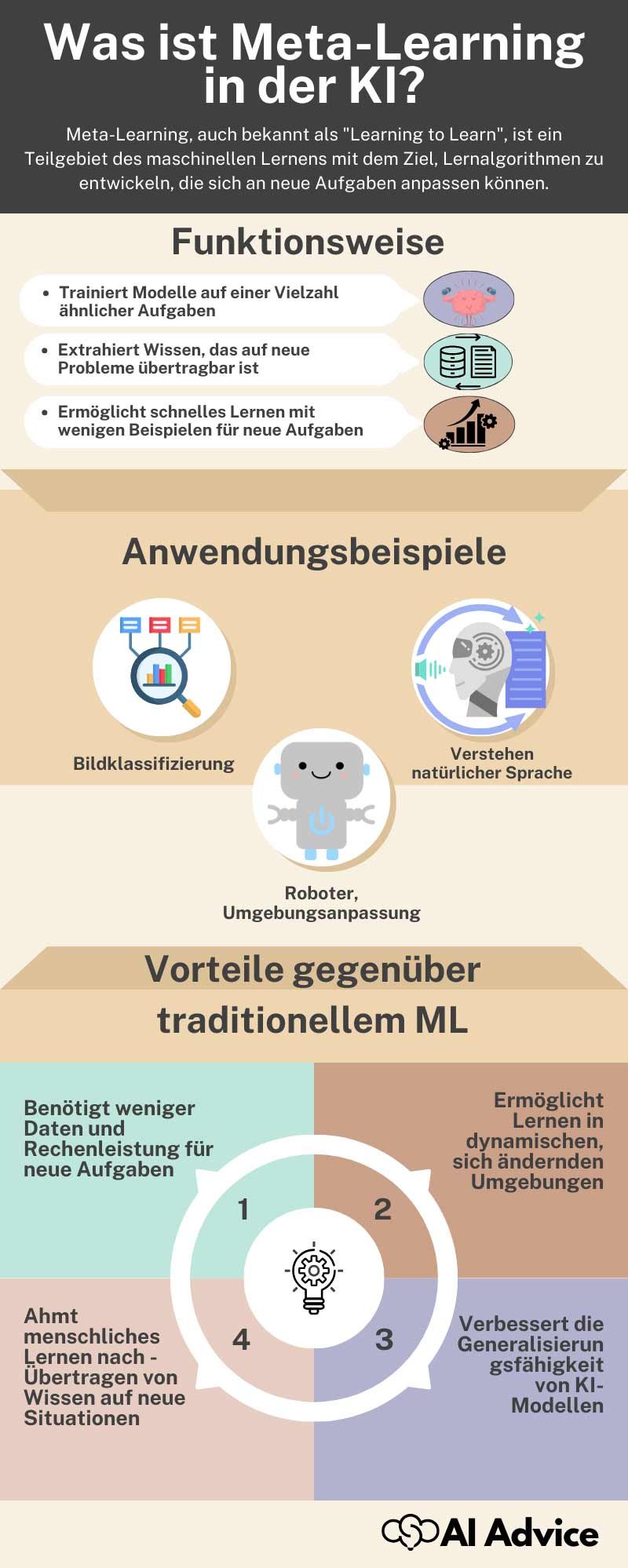

Meta-Learning ist ein fortschrittlicher Bereich innerhalb der Künstlichen Intelligenz, der darauf abzielt, grundlegend zu verbessern, wie Maschinen lernen. Diese Art des Lernens, oft als „Lernen zu lernen“ beschrieben, ermöglicht es AI-Systemen und Maschinenlernalgorithmen, aus vergangenen Erfahrungen zu profitieren und sich effizienter an neue Aufgaben anzupassen. Es greift Konzepte auf, die Meta-Gedächtnis und Meta-Kognition in der menschlichen Intelligenz nachempfinden und erweitert diese um die Dimension der technologischen Evolution. Dieser Ansatz ist insbesondere im Bereich des Deep Learning von Bedeutung, wo Algorithmen große Datenmengen verarbeiten, um Aufgaben in verschiedenen Domänen wie der Spracherkennung, dem autonomen Fahren oder der Bildanalyse zu meistern.

In der Praxis arbeitet Meta-Learning mit einer Vielzahl von Methoden, um maschinelle Lernmodelle effizienter zu gestalten. Dazu gehören Optimierungsbasierte Ansätze, bei denen ein Meta-Lerner lernt, wie am besten die Parameter eines Modells eingestellt werden sollten. Auch werden Meta-Modelle verwendet, die in der Lage sind, Predictions über die Effektivität verschiedener Lernstrategien zu treffen. Unternehmen nutzen diese Technologie, um beispielsweise Compliance, Datenschutz und IT-Sicherheit zu verstärken, indem schnell adaptive Lösungen entwickelt werden, die mit neuen oder sich verändernden Anforderungen umgehen können.

Schlüsselerkenntnisse

- Meta-Learning verbessert die Effizienz von AI durch Erfahrungstransfer zwischen Aufgaben.

- Optimierungsbasierte Ansätze und Meta-Modelle sind wesentliche Technologien des Meta-Lernens.

- Meta-Learning-Anwendungen sind vielfältig und reichen von Compliance bis hin zu autonomen Systemen.

Was ist Meta-Learning und warum ist es wichtig für KI?

Meta-Learning, oder auch das Lernen zu lernen, ist eine revolutionäre Entwicklung im Bereich der künstlichen Intelligenz (KI), die es Algorithmen ermöglicht, aus Erfahrung zu lernen und ihre Performance durch Generalisierung zu verbessern. Dieser Ansatz zielt darauf ab, dass KI-Systeme eigenständig lernen, ihre Lernprozesse zu optimieren und sich effektiv an neue Aufgaben anzupassen.

Die Grundlagen des Meta-Lernens verstehen

Meta-Learning verbessert die Fähigkeit von KI-Systemen, indem es ihnen ermöglicht, aus vergangenen Erfahrungen zu lernen und diese beim Lösen neuer, ähnlicher Aufgaben anzuwenden. Der Kern dieses Konzeptes basiert auf der Entwicklung von Algorithmen, die ihre eigenen Lernprozesse analysieren und optimieren. Diese Algorithmen sind oft als neuronale Netze strukturiert, die Parameter anpassen, um zukünftige Lernaufgaben effektiver zu bearbeiten.

Wie Meta-Learning die Fähigkeit der KI zur Generalisierung verbessert

Durch Meta-Learning werden Algorithmen darauf trainiert, Muster und Strukturen in den Daten zu erkennen, was zu einer besseren Generalisierung auf unbekannte Daten führt. Generalisierung ist die Fähigkeit eines Lernmodells, Wissen von vollzogenen Lernaufgaben auf neue, unbekannte Aufgaben zu übertragen. Das Ergebnis ist eine KI, die mit wenigen Beispielen oder Datenpunkten effizient lernen und sich an neue Situationen anpassen kann.

Der Unterschied zwischen Meta-Learning und traditionellem maschinellen Lernen

Im Gegensatz zu traditionellem maschinellen Lernen, bei dem Modelle für eine spezifische Aufgabe mit großen Datenmengen trainiert werden, fokussiert sich Meta-Learning auf die Entwicklung der Fähigkeit, schnell und effizient von wenigen Daten zu lernen. Traditionelle Lernalgorithmen benötigen häufig eine große Menge an Trainingsdaten und sind auf eine konkrete Aufgabe beschränkt, während Meta-Learning-Modelle darauf abzielen, aus einer Vielzahl von Aufgaben zu lernen und sich dabei kontinuierlich anzupassen.

Die Schlüsseltechnologien hinter Meta Learning

Meta-Learning ist ein Feld des maschinellen Lernens, das Algorithmen nutzt, um aus Erfahrungen über viele Lernaufgaben zu lernen und schnell Wissen auf neue, unbekannte Aufgaben zu übertragen. Diese Technologie verwendet spezielle Algorithmen und Architekturen, um die Leistungsfähigkeit des Lernmodells mit wenigen Daten zu optimieren.

MAML (Model-Agnostic Meta-Learning) und seine Bedeutung

MAML ist ein Ansatz in Meta-Learning, der es ermöglicht, dass ein Lernalgorithmus effektiv über eine Vielzahl von Aufgaben hinweg lernen kann, ohne auf eine spezifische Modellarchitektur angewiesen zu sein. Dies geschieht durch die Anpassung der Modellparameter mittels eines spezialisierten Verfahrens des Gradientenabstiegs, wodurch das Modell schnell zu neuen Aufgaben generalisieren kann.

- Grundprinzip: Anpassungsfähige Initialparameter für verschiedene Tasks

- Vorteil: Flexibel über diverse Modellarchitekturen

- Ziel: Schnelle Adaptation an neue Lernaufgaben

Few-Shot Learning und die Überwindung von Datenbeschränkungen

Few-Shot Learning ist eine Methode im Meta-Learning, die es Modellen ermöglicht, gute Performance bei Klassifizierungsaufgaben zu erreichen, auch wenn nur wenige Beispiele (Shots) für jede Klasse vorhanden sind. Dies stellt einen bedeutenden Fortschritt in Szenarien dar, in denen große Datensätze nicht verfügbar oder zu kostspielig zum Erwerb sind.

- Herausforderung: Lernen mit Minimaldaten

- Lösungsansatz: Nutzen der Meta-Lernfähigkeiten zur besseren Generalisierung

Prototypische Netzwerke und Matching-Netzwerke im Vergleich

Prototypische Netzwerke und Matching-Netzwerke sind zwei Architekturen, die im Kontext von Few-Shot Learning Anwendung finden. Sie bilden Prototypen jeder Klass auf Basis der vorhanden Daten. Zielt ist die Klassifizierung durch Vergleich der Nähe zu diesen Prototypen.

Matching-Netzwerke:

- Verwenden eine Mischung aus Einbetten der Beispiele und Aufmerksamkeitsmechanismen, um eine Vorhersage zu treffen

- Spezifikation: Ermöglichen die flexible Zuordnung von neuen Beispielen zu bekannten Klassen, selbst bei minimalen Daten

Jede dieser Architekturen hat ihren eigenen Ansatz und Vorteile bei der Bewältigung von Few-Shot Learning Problemen, indem sie unterschiedliche Strategien zur Modellierung von Wissen anwenden, was sie zum wichtigem Bestandteil der Schlüsseltechnologien in Meta-Learning macht.

Meta-Learning Ansätze in der Praxis

Meta-Learning, auch bekannt als „Lernen zu Lernen“, hat sich mit seiner Fähigkeit, Modelle für eine Vielzahl von Aufgaben zu optimieren, als ein revolutionärer Ansatz in vielen Forschungsbereichen erwiesen. Sie profitieren von Meta-Learning, indem Ihre Modelle Erfahrungen aus vorangegangenen Lernaufgaben nutzen, um sich schneller an neue Aufgaben anzupassen.

Anwendungen des Meta-Lernens in der Computer Vision

Im Bereich der Computer Vision ermöglicht Meta-Learning neuralen Netzen, sich schnell an neue Aufgaben wie Objekterkennung anzupassen. Forschungsergebnisse zeigen, dass Modelle, die mit Meta-Learning-Methoden trainiert wurden, weniger Beispielaufnahmen benötigen, um neue Objekte zuverlässig zu erkennen. Dies wird besonders in Forschungsfeldern wie der medizinischen Bildanalyse genutzt, wo Ihre Modelle schnell und präzise neue visuelle Kategorien identifizieren müssen.

Meta-Learning in der Verstärkungslernumgebung

Verstärkungslernen profitiert erheblich von Meta-Learning, insbesondere bei der Entwicklung von Lernstrategien, die über einzelne Lernepisoden hinausgehen. Meta Reinforcement Learning-Ansätze befähigen Agenten dazu, vorherige Interaktionen mit der Umgebung zu nutzen, um zukünftige Entscheidungen besser zu informieren. Das heißt, Ihre Agenten können in komplexen Szenarien adaptiver und schneller kompetent werden.

Wie Meta-Learning die Entwicklung neuer Algorithmen inspiriert

Meta-Learning beeinflusst maßgeblich die Schaffung innovativer Algorithmen in Bereichen wie dem Natural Language Processing (NLP). Durch Meta-Learning werden Algorithmen entwickelt, die auf einer Vielzahl von Sprachdaten trainieren und sich schnell neuen Sprachen oder Dialekten anpassen können. Das erweitert die Grenzen gängiger NLP-Anwendungen und ermöglicht Ihnen den Einsatz adaptiverer und effizienterer NLP-Tools.

Herausforderungen und Grenzen beim Meta-Lernen

Beim Meta-Lernen stoßen Sie auf spezifische Herausforderungen, die die Optimierung von Modellen, die Bewältigung der Lernaufgabenkomplexität und die Entwicklung systematischer Ansätze umfassen.

Die Schwierigkeit der Optimierung von Meta-Learning-Modellen

Die Optimierung von Meta-Learning-Modellen ist aufgrund der notwendigen Abstimmung einer Vielzahl von Hyperparametern herausfordernd. Sie müssen eine Verlustfunktion überwachen, die auf eine effektive Generalisierung über multiple Lernaufgaben abzielt, was oft einen erhöhten Rechenaufwand bedeutet. Herausforderungen entstehen insbesondere bei der Modell-vor-Schulungsphase (Meta-Learning-Phase), wo ein Gleichgewicht zwischen Trainingszeiten und Modellleistung gefunden werden muss.

Der Umgang mit der Komplexität und Vielfalt der Lernaufgaben

Im Meta-Learning ist es Ihr Ziel, eine hohe Generalisierungsfähigkeit zu erreichen, was bei der enormen Komplexität und Vielfalt der Lernaufgaben schwierig sein kann. Multitask-Learning stellt dabei hohe Anforderungen an die Verarbeitung und Integration von Metadaten, was die Datenverfügbarkeit zu einer wesentlichen Herausforderung macht. Sie müssen sicherstellen, dass die Metadaten repräsentativ für die Vielfalt der Aufgaben sind, um effektives Lernen zu gewährleisten.

Systematische Ansätze zur Überwindung dieser Grenzen

Um die Grenzen im Meta-Learning zu überwinden, ist kontinuierliche Forschung nötig. Sie sollten systematische Ansätze entwickeln, die effizient mit Datenknappheit umgehen und gleichzeitig die erforderlichen Rechenanforderungenminimieren. Dies erfordert eine tiefergehende Forschung in Lernalgorithmen, die in der Lage sind, auch mit begrenzten Daten erfolgreiche Generalisierungen zu ziehen. In der KI-Forschung sind Innovationen gefragt, um Modelle zu schaffen, die diese Herausforderungen bewältigen.

Zukünftige Richtungen des Meta-Lernens in neuronalen Netzwerken

In der zukünftigen Entwicklung von Meta-Lernen in neuronalen Netzwerken sehen Sie eine Verschiebung hin zu integrativeren Ansätzen, die Transfer-Lernen und verbesserte Generalisierung betonen. Dies soll ein erweitertes Verständnis der Grenzen des maschinellen Lernens ermöglichen.

Neue Horizonte durch Kombinieren verschiedener Meta-Learning-Ansätze

Neurale Netzwerke profitieren von der Kombination verschiedener Meta-Learning-Methoden wie model selection und ensemble learning. Die Zusammenführung dieser Techniken kann zu einer verbesserten Performance und einer effizienteren Anwendung auf diverse Lernprobleme führen. Insbesondere könnte diese Entwicklung dazu beitragen, die Generalisierungsfähigkeit der KI-Systeme zu stärken.

Die Rolle des Transfer-Lernens und der Generalisierung für zukünftige KI-Systeme

Ihr Einfluss auf das Meta-Lernen wird maßgeblich durch Transfer-Lernen und domain adaptation geprägt. Zukunftsträchtige KI-Systeme müssen lernen, Wissen effektiv zwischen Aufgaben zu übertragen, um auf ein breiteres Spektrum von Problemen anwendbar zu sein. Nur durch eine hohe Generalisierungsleistung kann eine KI die Grenzen bestehender Anwendungen erweitern.

Wie Meta-Learning die Grenzen des maschinellen Lernens erweitern könnte

Meta-Learning, oder das „Learning-to-Learn“, befähigt neuronale Netzwerke dazu, aus vergangenen Erfahrungen zu lernen und die eigene Lernstrategie zu optimieren. Dadurch könnte state-of-the-art KI nicht nur spezifische Aufgaben lösen, sondern auch neue, unbekannte Herausforderungen bewältigen. Effizientes Meta-Learning ermächtigt Sie dazu, sich adaptiv an wechselnde Lernumgebungen und Problemstellungen anzupassen, was ein zentrales Element zukunftsorientierter, datengetriebener Technologien darstellt.